中小企業が知っておくべき「AIセキュリティ」の超基本:正しく恐れ、賢く使う

「ChatGPTは情報漏洩が怖い」「社員に勝手に使わせるのはリスクだ」。経営者として、その直感は非常に健全です。しかし、そこから「だから利用禁止にする」という決断を下しているとしたら、あなたはより巨大で、より深刻な「見えないリスク」に足を踏み入れているかもしれません。

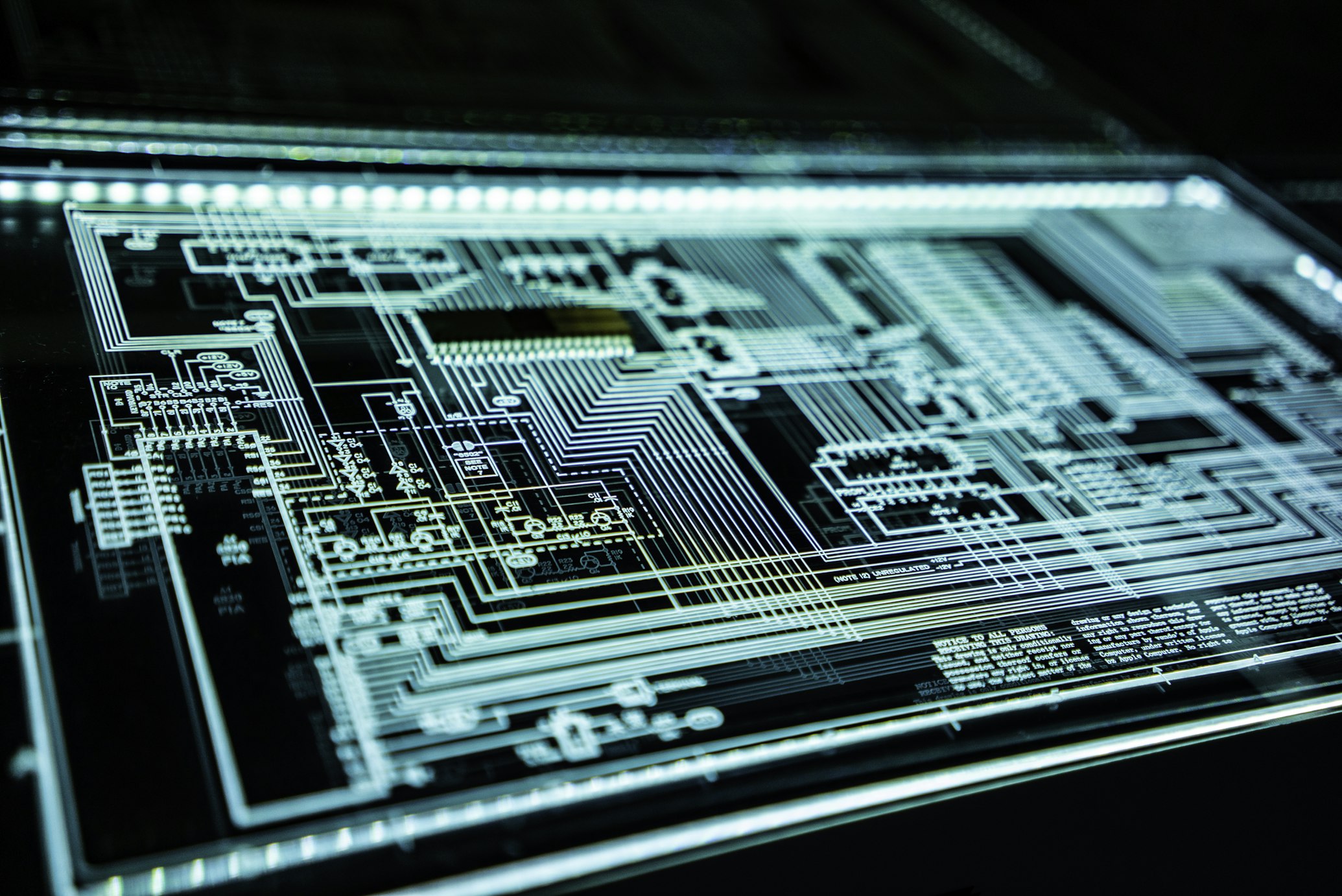

AIは、圧倒的な破壊力を持つ武器です。安全装置(セキュリティ)を理解せずに使うことは、ブレーキのないレーシングカーで公道を走るようなもの。しかし、その強力な武器を「禁止」しても、現場の社員は便利さゆえに、個人のスマホや隠れたブラウザからこっそりと使い始めます。これが、現代の企業セキュリティにおける最大の脅威、初期の「シャドーAI(影のAI)」です。今回は、中小企業がこの荒波を越えるための、最低限かつ最強の防衛策を解体します。

「禁止」が招く最悪の事態。リスクは「管理」するものであって「隠す」ものではない

社員が会社に黙って個人のChatGPTアカウントで顧客情報を分析する。無料翻訳ツールに機密文書をアップロードする。禁止すればするほど、これらの行為は地下に潜り、経営者の目が届かないところで静かに、しかし確実に情報漏洩の火種を大きくします。

経営者がすべきは「禁止」ではなく、社内に安全な「通り道」を用意することです。「ここまではOK」「ここからはNG」という境界線を明確にし、リスクをコントロール可能な状態に置くこと。これが現代の情シス、そして経営者の責務です。

最大の誤解:「入力した情報はすべて筒抜けになる」?

多くの経営者が不安を抱く「データの学習」問題。結論から言えば、これは「プランと設定」次第で100%コントロール可能です。無料版のChatGPTを不用意に使えば、入力したプロンプトが将来のAIの学習に使われるリスクは否定できません。しかし、法人向けプラン(ChatGPT Team/Enterprise)やAPI利用であれば、入力したデータが学習に使われないことが規約で保証されています。この「技術的な真実」を理解するだけで、セキュリティ不安の8割は解消されます。

今日から現場に徹底させる、参謀流「AIセキュリティ3か条」

難解なマニュアルを作っても、現場は守りません。以下の3つの鉄則を、組織の血肉にしてください。

1. 個人情報・生の顧客データは「匿名化」せよ

AIに分析させる際、顧客名や具体的な会社名である必要はありません。A社、Bさん、といった仮名に置き換える。あるいは特定の個人に紐付くIDにする。この「匿名化」という一工程を挟むだけで、万が一の際のリスクは劇的に下がります。情報の「本質」だけをAIに渡す技術を身につけさせましょう。

2. 業務利用は必ず「会社支給の管理アカウント」で行え

私用アカウントの利用は一律禁止し、会社が管理するセキュアな環境を無償で社員に提供してください。コストがかかると思うかもしれませんが、情報漏洩によるブランド毀損と損害賠償に比べれば、月額数千円のライセンス料は「最も安い保険」です。

3. AIの回答は「嘘をつく」と心得よ

セキュリティはデータの流出だけではありません。「誤った情報に基づく意思決定」もまた、重大なリスクです。AIは時として、真実味のある嘘(ハルシネーション)をつきます。最終的なチェックは必ず人間が行う「Human-in-the-loop」の原則。これを徹底しない限り、AIは貴社の信頼を壊す地雷となります。

貴社のAI活用、今のままでは「地雷」を踏んでいるかもしれません

AI参謀パートナーズでは、技術的な実装だけでなく、社員向けのガバナンス構築、利用ガイドラインの策定までを一気通貫で支援します。

「正しく恐れ、賢く使い、競合に差をつける」。守りから攻めへと転じるための第一歩。まずは貴社の利用状況をプロが診断します。

参謀の格言:防御こそ最大の攻撃なり

強固な壁があるからこそ、兵士は安心して前線で戦えるのです。セキュリティをコスト(守り)と捉えるのではなく、社員が安心してクリエイティブにAIを使いこなすための「インフラ(攻め)」と再定義してください。その意識変革が、1年後の貴社の生産性に決定的な差をもたらします。私たちと共に、安全で力強い未来のオフィスを創り上げましょう。